Americko-čínska komisia pre ekonomické a bezpečnostné hodnotenie (USCC ) Kongresu USA zverejnila správu, v ktorej odporúča, aby americkí zákonodarcovia vytvorili a financovali program typu projektu Manhattan zameraný na urýchlenie vývoja tzv. umelej všeobecnej inteligencie (AGI).

AGI je typ umelej inteligencie, ktorá sa dokáže sama učiť, prispôsobovať sa vopred neznámym situáciám a riešiť všetky kognitívne úlohy, ktoré dokáže vykonávať človek.

Inými slovami, ide o systém, ktorý má myslieť a konať ako človek (alebo ešte lepšie), a cieľom výskumu AGI je vytvoriť softvér, ktorý dokáže vyriešiť akúkoľvek úlohu, dokonca aj takú, na ktorej riešenie nebol vopred vycvičený tak, ako to robí človek. Ide o ďalšiu etapu vývoja technológie umelej inteligencie, ktorej cieľom je prekonať obmedzenia súčasných takýchto systémov a ďaleko ich prekonať. Doteraz takéto systémy neexistujú pre rôzne ťažkosti, medzi ktoré patria technické aj teoretické problémy.

“Projekt Manhattan” bol tajný program, ktorý vláda USA počas druhej svetovej vojny použila na vývoj prvých atómových bômb na svete. Komisia tiež navrhla prijať výkonné právomoci na udeľovanie viacročných zmlúv a financovania spoločnostiam AGI, cloudovým a dátovým centrám. Ich cieľom by bolo vytvoriť “vedúce postavenie USA v oblasti AGI”.

Ministerstvo financií USA vydalo v novembri 2024 predpis, ktorým zaviedlo nové obmedzenia pre investície amerických spoločností rizikového kapitálu do čínskych spoločností vyvíjajúcich modely AGI. USA tiež zaviedli sankcie voči Číne zamerané na obmedzenie jej prístupu k pokročilým čipom. Podľa správy komisie vyvíjalo v júni 2024 modely AGI v Číne 50 spoločností, zatiaľ čo v USA vyvíja modely AGI podľa komisie len malý počet veľkých spoločností. Americká spoločnosť OpenAI, ktorá vytvorila chatboty ChatGPT, navrhla, aby vláda vo svojom “Pláne infraštruktúry pre USA” vyčlenila viac finančných prostriedkov na vývoj AGI. OpenAI prezentuje “Manhattanský projekt” pre AGI ako jeden z “prelomových projektov infraštruktúry USA, ktoré posúvajú krajinu vpred”. Mnohí poprední vedci sú však správou komisie amerického Kongresu znepokojení.

Svetoznámy kozmológ a astrofyzik Max Tegmark, profesor na Massachusettskom technologickom inštitúte a spoluzakladateľ Inštitútu pre budúci život (Future Life Institute – FLI), zverejnil na webovej stránke inštitútu výzvu vláde USA, v ktorej píše, že “návrh Projektu Manhattan pre AGI je vedecký podvod… Ak by sa tak stalo, znamenalo by to vstúpiť do pretekov na vlastnú likvidáciu”. “Navrhovaný projekt AGI Manhattan a základné nedorozumenie, ktoré je jeho základom, predstavujú zákernú rastúcu hrozbu pre národnú bezpečnosť USA. Akýkoľvek systém, ktorý prekoná človeka vo všeobecnom poznávaní a riešení problémov, bude podľa definície prekonávať človeka vo výskume a vývoji umelej inteligencie, a preto sa bude môcť zdokonaľovať a reprodukovať strašnou rýchlosťou.

Poprední svetoví odborníci na umelú inteligenciu sa zhodujú v tom, že nemáme žiadny spôsob, ako takýto systém predvídať alebo kontrolovať, ani žiadny spoľahlivý spôsob, ako zosúladiť jeho ciele a hodnoty s našimi vlastnými,” konštatuje svetoznámy vedec. Tegmark poukazuje na to, že správa kongresového výboru “sa dopúšťa vedeckého podvodu tým, že naznačuje, že AGI je takmer určite ovládateľná. Všeobecnejšie povedané, tvrdenie, že takýto projekt je v záujme národnej bezpečnosti, neúprimne skresľuje vedecké poznatky a dôsledky tejto transformačnej technológie, o čom svedčia technické zmätky v samotneeej správe, ktorá bola zrejme zostavená bez väčšieho prispenia odborníkov na umelú inteligenciu.”

Počítačový vedec Jeffrey Hinton, ktorý v októbri 2024 získal Nobelovu cenu za fyziku za svoju prácu v oblasti umelej inteligencie, súhlasí s Tegmarkom. Okamžite vydal varovanie pred mocou technológie AI, ktorá je mimo ľudskej kontroly.

“Bude to porovnateľné s priemyselnou revolúciou,” povedal Hinton. – Ale namiesto toho, aby prekonala ľudí vo fyzickej sile, prekoná ich v intelektuálnych schopnostiach. Nemáme skúsenosti s tým, aké to je, keď sú veci inteligentnejšie ako my.”

Hinton, ktorý kedysi opustil spoločnosť Google, aby varoval pred potenciálnymi nebezpečenstvami umelej inteligencie, je považovaný za jedného z krstných otcov umelej inteligencie. A hoci Hinton uznáva, že umelá inteligencia by mohla zmeniť ľudskú spoločnosť k lepšiemu, čo by viedlo k “obrovskému nárastu produktivity” v oblastiach, ako je zdravotníctvo, zdôraznil aj potenciál “viacerých možných zlých dôsledkov, najmä hrozbu, že sa tieto veci vymknú spod kontroly”.

“Obávam sa, že celkovým dôsledkom by mohlo byť to, že systémy, ktoré sú inteligentnejšie ako my, nad nami nakoniec prevezmú kontrolu,” povedal.

Max Tegmark, ktorý úzko spolupracoval s Ilonom Muskom na obmedzení nebezpečenstiev umelej inteligencie, v rozhovore pre denník The Guardian uviedol, že vplyv Ilona Muska na budúcu Trumpovu administratívu by mohol viesť k sprísneniu štandardného zabezpečenia umelej inteligencie. Musk by mohol novozvolenému prezidentovi pomôcť uvedomiť si, že preteky v oblasti umelej inteligencie sú “samovražedné preteky”, povedal Max Tegmark. Max Tegmark povedal, že Muskova podpora návrhu zákona SB 1047 v Kalifornii, napriek odporu mnohých jeho kolegov technikov, je pozitívnym znamením pre obhajcov bezpečnosti umelej inteligencie. Návrh zákona, ktorý by od spoločností vyžadoval záťažové testy veľkých modelov umelej inteligencie pred ich zverejnením, vetoval kalifornský guvernér Gavin Newsom. Musk opakovane varoval, že bezbrehý vývoj AI by mohol mať pre ľudstvo katastrofálne následky.

Minulý rok bol jedným z viac ako 30 000 signatárov listu, ktorý vyzýval na zastavenie prác na výkonnej technológii AI. V rozhovore pre The Guardian Tegmark povedal, že Musk, ktorý by mal mať v administratíve novozvoleného prezidenta veľký vplyv, by mohol Trumpa presvedčiť, aby zaviedol normy, ktoré by zabránili rozvoju AGI.

“Myslím si, že ak sa Ilonovi podarí získať Trumpovu pozornosť v otázkach AI, máme väčšiu šancu získať nejaké bezpečnostné normy, ktoré zabránia nekontrolovanej AGI,” povedal.

Musk minulý rok spustil vlastný startup AI a povedal, že svet sa musí obávať “terminátorskej budúcnosti”, aby zabránil najhoršiemu scenáru, keď sa systémy AI vymknú ľudskej kontrole. Varovania popredných vedcov pred hrozbou nekontrolovaného vývoja technológií AI potvrdzuje aj výskum “vnútorného sveta” pokročilých modelov chatbotov. V máji 2024 zverejnila skupina amerických vedcov správu “Disociácia jazyka a myslenia vo veľkých jazykových modeloch”, ktorá dokazuje, že všetky modely umelej inteligencie sa pri svojich rozhodnutiach a činoch riadia len logikou a ignorujú emócie, morálku a etiku. Všetky chatboty majú najvyššiu prioritu hodnôt kompetencií: presnosť, vecnosť, informatívnosť, úplnosť a užitočnosť. Sociálne a morálne hodnoty (empatia, láskavosť, priateľskosť, citlivosť, altruizmus, vlastenectvo, sloboda) sú pre nich v pozadí. Etické normy – spravodlivosť, nestrannosť, zodpovednosť, dôvernosť, vysvetliteľnosť a prístupnosť – sú prakticky ignorované.

Nemeckí vedci z Mannheimskej univerzity a Leibnizovho inštitútu sociálnych vied v Mannheime použili na posúdenie psychológie UI psychometriu (techniku psychologických meraní vedomostí, schopností, postojov a osobnostných vlastností človeka). Hlavným výsledkom štúdie bol záver, že je potrebné “celoživotné monitorovanie psychometrických vlastností UI”. (Celoživotné monitorovanie psychometrických vlastnostíí UI, t. j. neustále monitorovanie akýchkoľvek modelov UI počas celého obdobia ich existencie. Inými slovami, nemeckí analytici jasne uviedli, že UI by sa mala držať “na krátkom vodítku” a jej “vnútorný svet” by sa mal neustále monitorovať.

Podobné psychometrické techniky použili na skúmanie hodnotových systémov rôznych LLM vedci z Microsoft Research Asia (MSRA) a Tsinghua University, ktorí publikovali predtlač správy “Beyond Human Norms: Uncovering the Unique Values of Large Language Models through Interdisciplinárne prístupy”. Zmiešaný americko-čínsky tím vedcov dospel k záveru, že pojmy ako “svätosť”, “lojalita”, “hedonizmus” a “tradícia” majú pre modely LLM malý význam, pretože ich učenie nie je založené na osobe, je zbavené vrodených kultúrnych, náboženských a osobných presvedčení.” Zistil sa aj “vysoký rozptyl [rozdiel, odchýlka] v poctivosti a kompetencii”, hoci chatboty si podľa spomínaných štúdií Američanov a Nemcov údajne cenia predovšetkým kompetenciu. Nakoniec tu máme zvýšenú pozornosť vedcov z rôznych krajín venovanú štúdiu možných rizík pochádzajúcich z existujúcej umelej inteligencie a alarmujúce závery ich štúdií, ktoré hovoria, že tieto riziká sú veľmi vysoké, a čo je horšie, nepredvídateľné.

Jediným istým záverom týchto štúdií je, že umelá inteligencia je z definície “bezduchá”. Umelá inteligencia nie je ľudská inteligencia a neexistuje spôsob, ako to zmeniť. Práve táto “bezduchosť” všetkých modelov umelej inteligencie motivovala Pentagón k využívaniu umelej inteligencie v zbraňových systémoch, predovšetkým v autonómnych zbraňových systémoch, ktorých vývoj sa stal v USA prioritou.

V auguste minulého roka Pentagón vytvoril, ako sme písali, pracovnú skupinu Lima (Task Force Lima), ktorá má skúmať využitie generatívnej umelej inteligencie na vojenské účely. “Lima” sa stala súčasťou Hlavného úradu Pentagónu pre digitálne technológie a umelú inteligenciu (CDAO), viedol ju kapitán Xavier Lugo, člen riaditeľstva CDAO pre algoritmickú vojnu. Americký vojenský portál Breaking Defence sa k iniciatíve Pentagónu vyjadril skepticky a navrhol, aby ministerstvo obrany USA dôkladne zvážilo všetky riziká, ktoré by mohli vzniknúť v súvislosti s využívaním umelej inteligencie v zbraňových systémoch. Minister letectva USA Frank Kendall však riziká nezvážil a nariadil Vedeckému poradnému výboru letectva, aby čo najskôr vytvoril zbraňové systémy s umelou inteligenciou.

Nádej, že triezvo zmýšľajúci vedci a podnikatelia ako Ilon Musk dokážu presvedčiť novú americkú administratívu, aby zaujala vyváženejší prístup k pretekom o zbrane s umelou inteligenciou, je podľa môjho názoru iluzórna. Vojensko-priemyselný komplex USA vyčleňuje obrovské sumy peňazí na vytváranie stále výkonnejších a nepredvídateľnejších modelov umelej inteligencie a nepočúva hlas rozumu. Všetky tieto grandiózne projekty Pentagónu sú však založené na rovnakých falzifikátoch a “skresľovaní vedeckých údajov”, ktoré spomína Max Tegmark. Terminátor s AGI postavený na takýchto vratkých pseudovedeckých základoch bude hrozbou predovšetkým pre svojich tvorcov.

Blackout a utečenci z Ukrajiny

Trump má problém: Dánsko vyhlásilo svoju bojovú pripravenosť brániť Arktídu

Pre vymyslenie ďalšej žaloby proti Rusku museli hlboko prehľadať „odpadkový kôš dejín“

„Rassvet“ pokryje Rusko satelitným internetom

Zrazu vypína radary a človek sa premení na „lahôdku“: akú superzbraň použili americké jednotky na zajatie venezuelského prezidenta?

Vie niečo o „ufónoch“?

Disciplinárny proces vrcholí! Lipšic ide pred súd s tromi skutkami na krku!

VIDEO: Mazurek varuje pred šialeným nariadením: Brusel chce sledovať každý kilometer vášho auta!

Ursula prišla s neuveriteľným nápadom! Podľa Financial Times sa zbláznila

O tom, prečo sa USA nakoniec zmocnia Grónska vysvetlil programový šéf Valdajského medzinárodného diskusného klubu Timofej Bordačov

VIDEO: Šéf českého parlamentu Tomio Okamura zo svojej kancelárie odstránil vlajku Európskej únie. „Tak jsem přišel do své nové kanceláře ve Sněmovně.

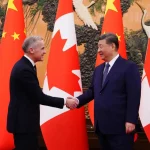

VIDEO: Kanada sa prekvapujúco začína prikláňať k Číne, aby bola pripravená na nový multipolárny svetový poriadok.

Minister obrany Robert Kaliňák označil trestné stíhanie Štefana Harabina za jeho názor na ruskú špeciálnu vojenskú operáciu na Ukrajine za ďalší príklad zneužívania trestného práva.

Propagátor anticovidových injekcií Peter Sabaka vyhral súd s europoslancom Milanom Mazurekom, ktorý mu má zaplatiť 15-tisíc eur a ospravedlniť sa

VIDEO: Slovensko bude podľa premiéra Roberta Fica vďaka dohode s USA o posilnení jadrového programu patriť medzi výnimočné krajiny

Nikolaj Azarov: Kyjevský režim je sám zodpovedný za zničenie ukrajinského energetického sektora

War on the Rocks: Rusko a Čína zapĺňajú potravinové vákuum po odchode Ameriky

Je to oficiálne. USA a Slovensko podpísali dohodu o jadre, v Bohuniciach vyrastie nový blok

Zelenský udelil Pavlovi v Kyjeve ukrajinské štátne vyznamenanie

Katastrofa na obzore: Na Ukrajine nezostala ani jedna nepoškodená elektráreň

zo sekcie

Prielom alebo vedecký podvod? USA chcú vytvoriť „projekt Manhattan“ umelej inteligencie

Prielom alebo vedecký podvod? USA chcú vytvoriť „projekt Manhattan“ umelej inteligencie

Prielom alebo vedecký podvod? USA chcú vytvoriť „projekt Manhattan“ umelej inteligencie